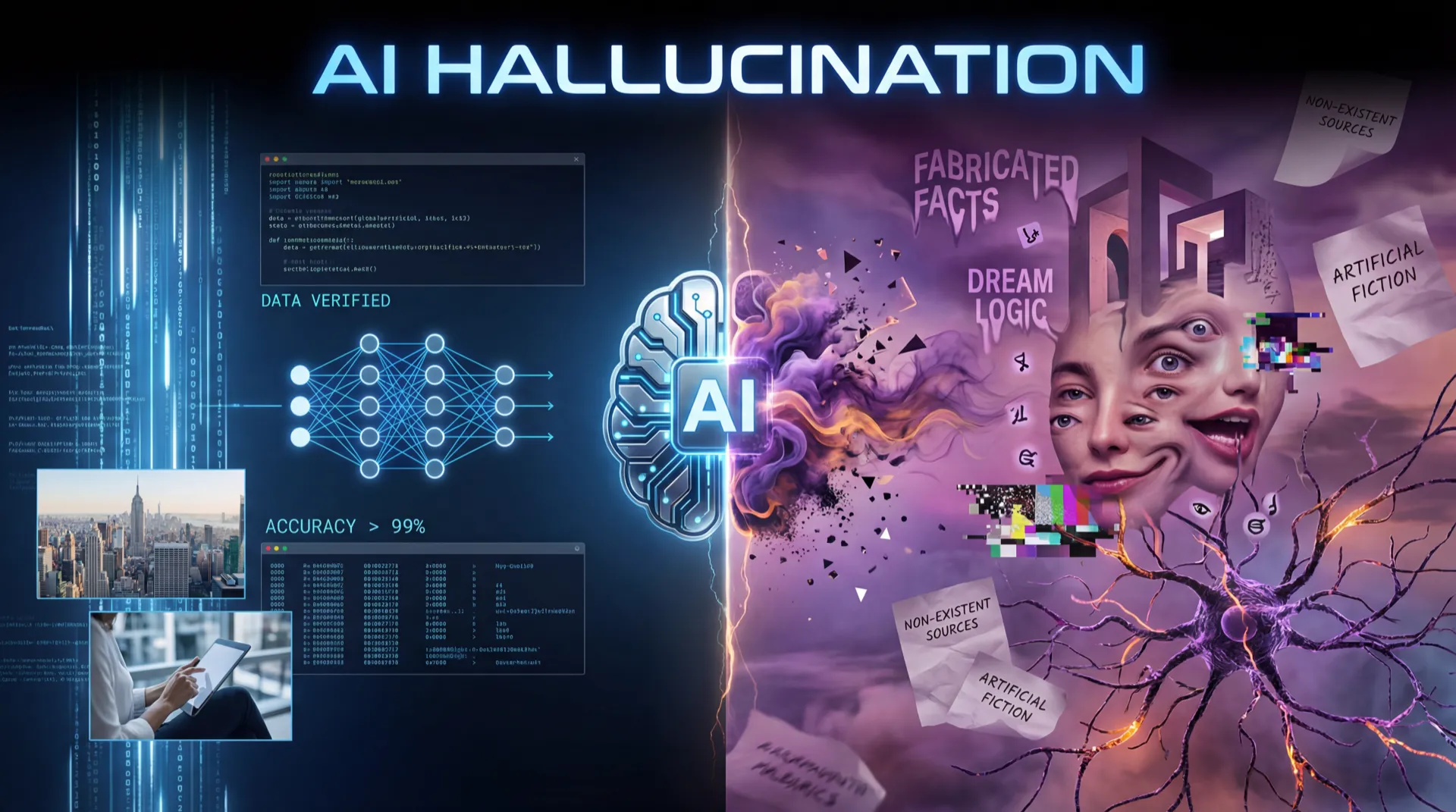

當 AI 自信地說錯話

你是否曾經問 AI 一個公司內部的流程問題,然後得到一個聽起來非常合理、但完全不符合公司實際規定的答案?更糟的是,答案說得如此自信,讓人難以察覺其中的錯誤。

這就是 AI 幻覺(AI Hallucination)——語言模型生成看似合理但實際上不正確的資訊。根據多項企業 AI 採用研究,85% 的企業 AI 導入失敗案例最終都能追溯到知識庫品質問題,而非模型本身的能力不足。對企業而言,AI 幻覺不只是「答錯了」這麼簡單——這些錯誤的後果是業務損失、客戶投訴,甚至法律責任。

幻覺的三個根本原因

要解決 AI 幻覺問題,必須先理解它為什麼發生。在企業部署場景中,幻覺通常源自三個核心問題。

知識庫品質低落

這是最被忽視、也是影響最深遠的問題。許多企業在建立 AI 知識庫時,把所有文件一次性地批量上傳,包括格式混亂的 Word 文件、掃描版的 PDF、缺乏結構的 Excel 表格,甚至是口語化的 LINE 聊天記錄。更常見的問題是知識庫的碎片化:相關資訊散佈在多個文件中,沒有明確的引用關係。

缺乏來源引用機制

傳統的 RAG(Retrieval-Augmented Generation)系統從知識庫中檢索相關段落,但許多實作在最終輸出時,並不會告訴使用者「這個答案是從哪裡來的」。沒有來源引用的 AI 回答,與 AI 憑空生成的回答在外觀上完全相同。

知識庫內容過期

企業的政策、規定、流程是會更新的。當 AI 從一個已過期的文件中擷取資訊並自信地回答問題,它在技術上沒有「說謊」——但對使用者來說,結果與幻覺並無二致。

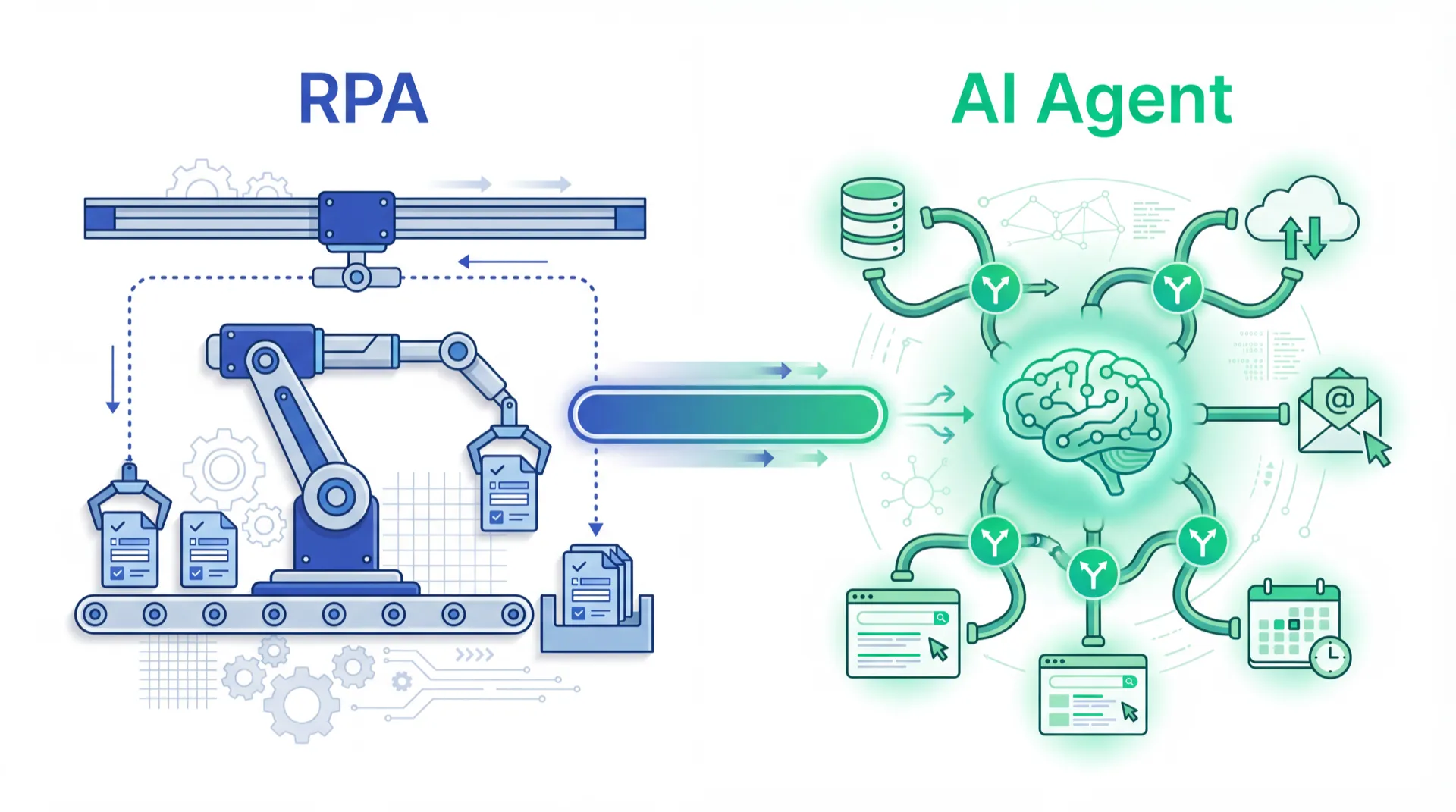

Agentic RAG:解決幻覺的技術框架

傳統 RAG 的工作流程相對線性:接收問題 → 向量檢索 → 生成答案。Agentic RAG 引入了更智慧的處理機制,有三個關鍵的技術進步。

檢索驗證(Retrieval Verification)

在生成最終答案之前,系統會主動評估檢索到的文件片段是否真的與問題相關。如果相關性分數低於閾值,系統會選擇重新檢索。根據學術研究,Agentic RAG 架構可以將企業 AI 的幻覺率降低 42% 到 68%。

信心分數(Confidence Scoring)

系統會為每個生成的答案計算信心分數。當信心分數低於設定閾值時,系統可以明確告知使用者「這個問題我沒有足夠的資料回答」,或觸發人工審核流程。

來源引用(Source Citation)

要求 AI 系統在每個回答中明確標注「這個答案來自文件 X 的第 Y 頁第 Z 段」,讓使用者可以自行驗證答案的準確性,建立對 AI 系統的理性信任。

知識庫品質:被低估的關鍵投資

70% 的組織已經在使用某種形式的 AI 知識管理系統,但其中真正做到高品質知識庫維護的比例仍然偏低。

結構化優先:盡可能將非結構化資料轉化為結構化格式,明確標注文件的類型、適用範圍、生效日期和版本號。

單一真實來源(Single Source of Truth):同一份知識只存在於一個位置,避免多個版本相互矛盾。

定期更新機制:建立文件過期提醒和強制更新流程。

覆蓋率意識:定期分析員工向 AI 提出但 AI 無法回答的問題,找到知識庫的空白地帶。

MaiAgent AI KM:從架構到實踐

MaiAgent 的 AI KM 將上述技術原則整合進一個對企業 IT 友善的產品中。AI KM 採用 Agentic RAG 框架,內建檢索驗證和信心分數機制,每個回答都附帶引用來源,精確到文件名稱和段落位置。

AI 幻覺是企業 AI 從試驗走向真實業務場景的最大障礙。解決之道不是換更好的模型,而是建立更好的知識基礎。

想看看 MaiAgent 如何讓 AI 每次回答都附上來源?了解 AI KM 技術架構 →

常見問題

Agentic RAG 和傳統 RAG 的主要差別是什麼?

傳統 RAG 的工作流程是線性的,整個過程是一次性的。Agentic RAG 引入了迭代和自我評估機制,讓系統面對複雜問題時更有韌性,也更能識別自身知識的邊界。

我的企業知識庫目前只有 Word 和 PDF 文件,能直接用嗎?

可以,但建議在上傳前進行品質預處理。掃描版的 PDF 需要 OCR 處理;多個版本並存的文件應先整理清楚再上傳。MaiAgent AI KM 提供上傳前的文件品質評估功能。

如果 AI 的信心分數低,應該怎麼處理?

有三種常見的處理策略:設定閾值讓低信心回答觸發人工審核;讓 AI 在回答時明確標注不確定性;將低信心問題自動加入知識庫待補充清單。

知識庫多大規模才足夠用於企業 AI?

知識庫的品質比數量重要得多。一個包含 200 份高品質、結構清晰的核心文件的知識庫,通常比 2000 份品質參差不齊的文件效果好得多。