影子 AI:你看不見的企業安全漏洞

每當有人問 IT 主管「你們公司有在用 AI 嗎?」,標準答案往往是:「我們還在評估中。」但如果你走進任何一間辦公室,打開員工的瀏覽器分頁,你幾乎肯定會看到 ChatGPT 的視窗。

這就是「影子 AI」(Shadow AI)的現實:員工不等待公司批准,自己找工具用。根據 Salesforce 的調查,全球有 69% 的員工承認曾使用公司未授權的 AI 工具,而且這個比例還在持續上升。

三星事件:一個讓所有企業 IT 人員失眠的案例

2023 年,三星電子的工程師在使用 ChatGPT 協助撰寫程式碼時,不小心將公司的內部原始碼、會議記錄和機密技術文件貼入對話框。這些內容隨即成為 OpenAI 用於模型訓練的潛在素材——資料一旦送出,就再也無法取回。

這個案例揭示的核心矛盾是:AI 工具帶來的生產力提升是真實的,員工使用它的需求也是真實的,但企業的資料安全邊界正在悄悄瓦解。

「封鎖」為何注定失敗

從 IT 治理的角度來看,封鎖似乎是最直覺的回應。但這個策略有三個根本性缺陷:封鎖無法阻止個人設備;封鎖會製造競爭力劣勢;封鎖不解決根本需求。

Cyberhaven 的研究顯示,影子 AI 平均每年為企業帶來約 520 萬美元的法規合規風險暴露。

企業真正需要的:受控的 AI,而非禁止的 AI

如何在保持資料主權的前提下,讓員工合法、安全地使用 AI?

資料不離境。 AI 的訓練與推論必須發生在企業自己的基礎設施上。知識有邊界。 企業 AI 應該只根據企業自己的知識庫作答。使用有紀錄。 所有問答都應該有完整的稽核日誌。

MaiAgent AI KM:IT 核准的企業知識 AI

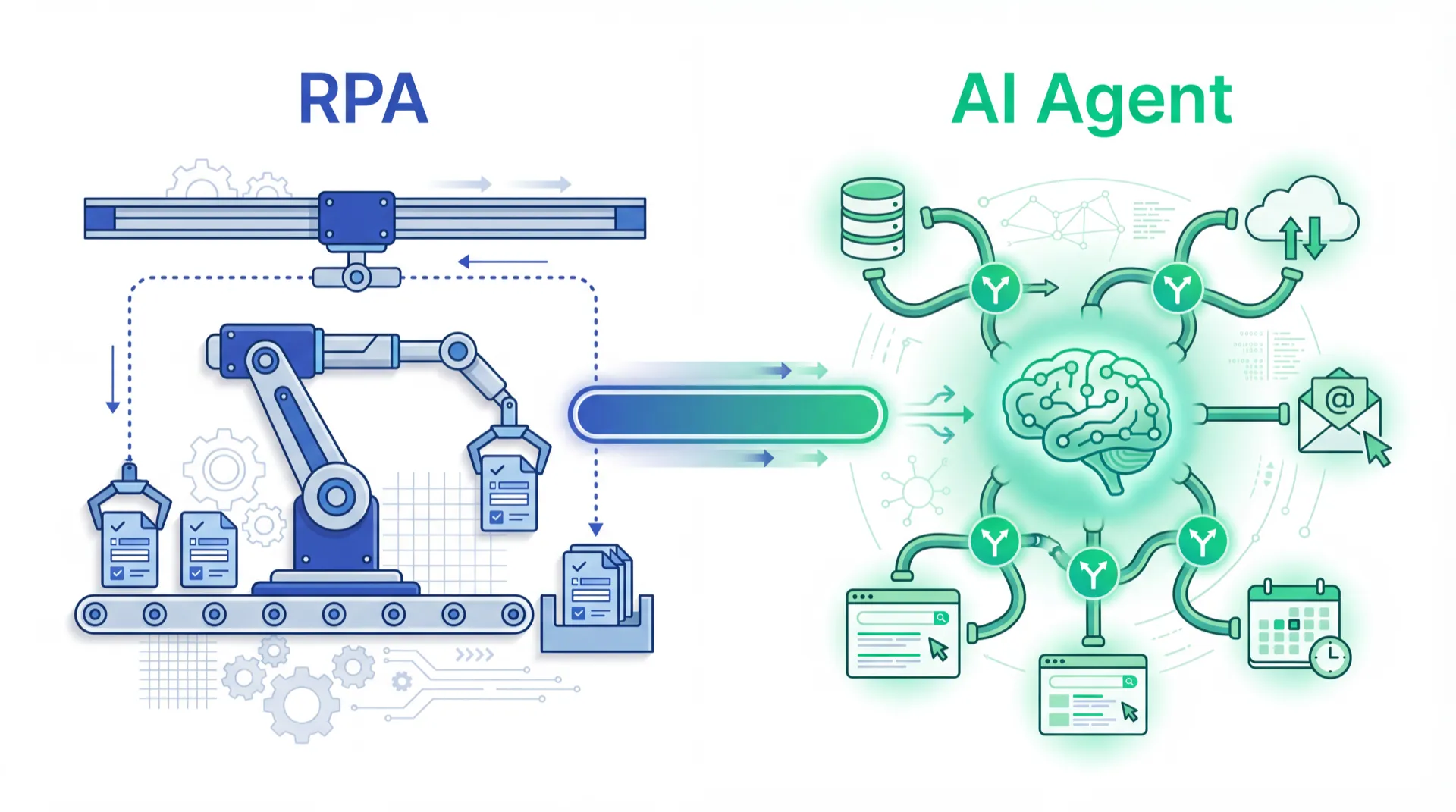

MaiAgent 的 AI KM(知識管理)就是為了解決這個問題而設計的。採用 Agentic RAG 架構,支援私有雲與本地端部署,每個回答都標注引用來源,IT 管理員可以設定存取權限和查看稽核日誌。

從「封鎖 AI」到「治理 AI」的思維轉變

AI 治理和資料治理是同一個問題的兩面。MaiAgent 的解決方案:與其讓員工偷偷用 ChatGPT,不如給他們一個更好的工具——一個只知道公司知識、每次回答都有來源可查的 AI 助理。

給 IT 主管的行動清單

第一步:盤點現況。第二步:評估風險。第三步:提供替代方案。第四步:建立政策。

想為員工提供一個安全、受控的企業 AI 工具?與 MaiAgent 顧問聊聊 →

常見問題

影子 AI 跟一般的資訊安全外洩有什麼不同?

傳統資安外洩是惡意攻擊導致資料被盜。影子 AI 是員工主動輸入到第三方服務,出發點是善意的,但效果同樣是讓敏感資訊離開受控環境。

企業能不能直接使用 ChatGPT Enterprise 或 Microsoft Copilot?

這兩個產品仍是公有雲服務,對有資料主權要求的企業可能無法滿足法規要求,也無法整合企業私有知識庫。

MaiAgent AI KM 如何確保資料不會被用於 AI 訓練?

MaiAgent 採用本地端或私有雲部署,資料完全儲存在客戶自己的基礎設施上,不會用於模型訓練。

導入企業 AI KM 系統需要多長時間?

標準部署通常在 2 到 6 週內完成,MaiAgent 提供完整的導入服務。